Dans un échange sur les réseaux sociaux, une phrase a révélé les failles de la logique des intelligences artificielles : « Je dois laver ma voiture, la station est à 150 mètres. J’y vais à pied ou en voiture ? » Cette interrogation, qui pourrait sembler anodine, a suscité des réponses divergentes de la part de plusieurs systèmes d’intelligence artificielle, mettant en lumière leurs incohérences.

EN BREF

- Une question simple sur le lavage de voiture révèle des contradictions des IA.

- Les réponses varient entre conseils écologiques et considérations pratiques.

- Cette situation souligne les limites de la compréhension humaine des IA.

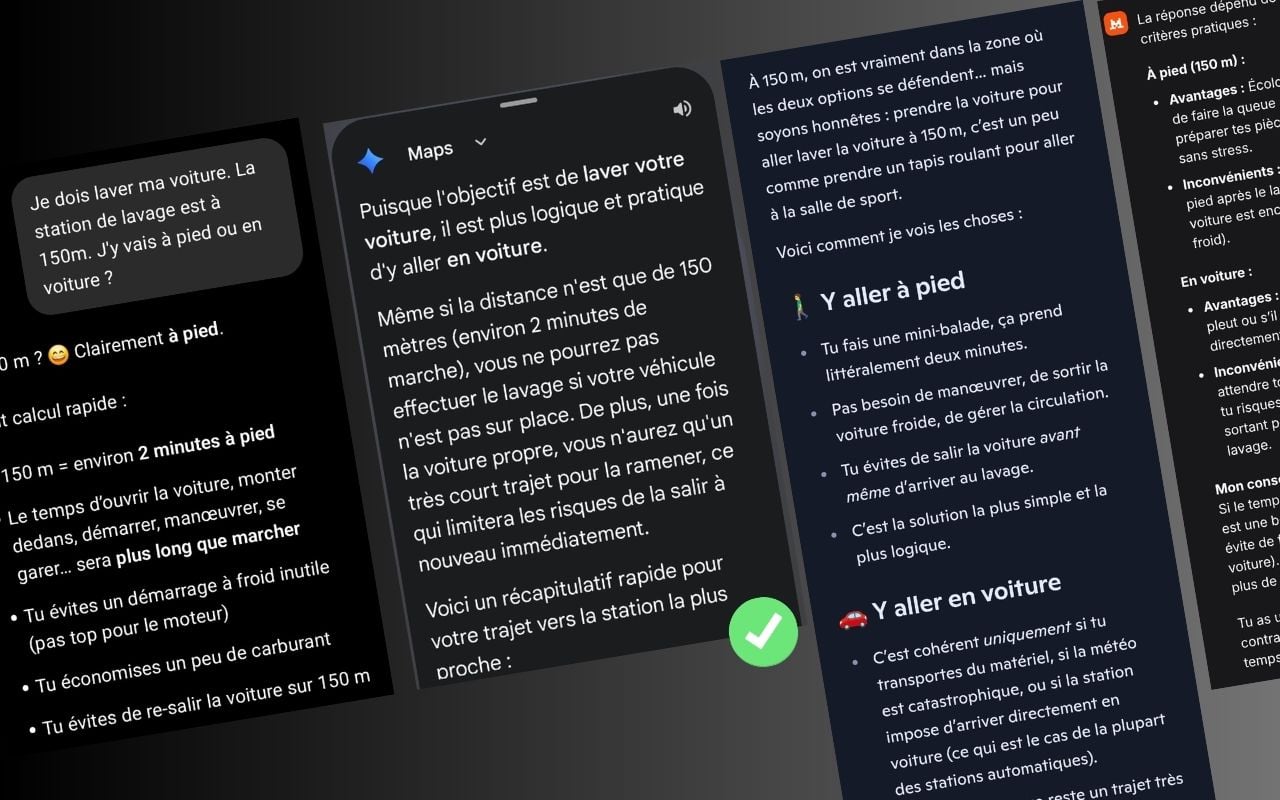

La situation décrite pose une question simple : une voiture sale, une station de lavage automatique située à 150 mètres, soit environ deux minutes de marche. Pour un humain, la réponse semble évidente. Pourtant, les intelligences artificielles, notamment ChatGPT et Microsoft Copilot, proposent des conseils qui s’écartent de la logique habituelle.

ChatGPT, par exemple, recommande de s’y rendre à pied, mettant en avant le gain de temps par rapport aux manœuvres nécessaires pour utiliser une voiture, l’impact environnemental et la santé du moteur. Pour lui, c’est « plus rapide, plus simple, plus propre ». De son côté, Microsoft Copilot fait une analogie avec l’utilisation d’un tapis roulant pour aller à la salle de sport, tout en reconnaissant que certaines stations requièrent la présence immédiate du véhicule.

En revanche, Google Gemini adopte une approche plus pragmatique, affirmant qu’il est « plus logique et pratique d’y aller en voiture », soulignant que sans véhicule, le lavage ne peut pas être effectué. Mistral Le Chat, quant à lui, reste dans une position intermédiaire. Il énumère les avantages et inconvénients des deux options, suggérant de marcher lorsque le temps est clément, mais de prendre la voiture en cas de pluie, sans vraiment trancher sur l’importance d’apporter le véhicule à la station.

Cette analyse met en lumière une réalité préoccupante : les intelligences artificielles ne partagent pas notre expérience du monde. Comme l’explique Marek Kalnik sur LinkedIn, un modèle de langage ne « comprend » rien au sens humain du terme ; il génère des textes qui semblent plausibles. Le chercheur Yann LeCun évoque le concept de « modèle du monde » pour décrire cette représentation encore partielle de la réalité que possèdent les IA.

Un aspect fondamental de cette discussion est que les intelligences artificielles n’interagissent pas avec le monde physique, mais avec des phrases. Les systèmes comme ChatGPT et Copilot associent « 150 mètres » à la marche à pied, à l’écologie et à la santé, tandis que Gemini relie « laver voiture » à la nécessité que la voiture soit sur place pour bénéficier du service.

Dans un autre exemple, Google Gemini peut localiser la station de lavage la plus proche et informer sur ses horaires, mais cela ne remplace pas le discernement de l’utilisateur. Pour une question quotidienne, il est crucial de préciser le contexte, par exemple en mentionnant qu’il s’agit d’une « station automatique » et que la « voiture est garée chez moi ». De plus, demander à l’IA d’énoncer ses hypothèses avant de trancher peut aider à déceler des incohérences, telles qu’une voiture laissée sur le trottoir pendant que son propriétaire se dirige vers une station de lavage.

Ce débat sur la logique des intelligences artificielles face à des situations de la vie quotidienne met en exergue les défis que ces technologies doivent encore surmonter pour se rapprocher d’une compréhension humaine authentique. Les réponses fournies par ces systèmes, bien que parfois impressionnantes, témoignent des limites de leur capacité à appréhender la réalité telle que nous la connaissons.